Carla仿真驱动的多模态端到端自动驾驶:一种双边模态交互方法

在此提供了 8 个城镇的多样化驾驶环境,生成** 231K 帧训练数据**(包含图像、LiDAR 点云等),并通过 Town05 Long 的 10 条长路线(1000-2000 米)测试模型性能。中,BiFusion 取得了驾驶分数(DS)69.6、路线完成率(RC)99.8 和违规分数(IS)0.70,显著优于现有方法,展示了其在交通灯处理、避障和导航等复杂场景中的卓越性能。,通过在表示学习和

编者荐语:

本文提出了一种创新的多模态端到端自动驾驶网络BiFusion,通过双边模态交互充分利用RGB图像与LiDAR点云的互补特性,提升自动驾驶系统的感知与决策能力。在CARLA的高精度仿真环境中,BiFusion实现了对复杂驾驶场景的精确建模,并在Town05 Long基准测试中取得了卓越的性能表现。本文发表在人工智能领域国际顶尖期刊Expert Systems With Applications上。一起来速读全文,洞悉前沿技术动态!

-

论文链接:

-

https://linkinghub.elsevier.com/retrieve/pii/S0957417425020779

-

论文代码:

-

https://github.com/YzMark2r/BiFusion

BiFusion 框架概述

亮点直击

-

•BiFusion 是一种创新的多模态端到端自动驾驶网络,通过双边模态交互策略,在表示学习和路径点预测中实现图像和 LiDAR 数据的双向互补,以充分利用两者的互补信息。

-

CRIM(跨模态表示交互模块) 通过跨视图位置嵌入和基于注意力的表示交互,建立了图像和 LiDAR 特征之间的像素到点对应关系,实现高效的特征融合。

-

CPIM(跨模态预测交互模块) 利用掩码自注意力机制和基于注意力的预测交互,实现了自回归路径点预测和跨模态信息交互,提升了预测精度。

-

在 Carla Town05 Long 基准测试 中,BiFusion 超越了现有最先进的方法,证明了其在复杂驾驶场景中的优越性和有效性。

总结速览

解决的问题

传统自动驾驶系统在多模态数据融合中常采用单边融合策略,仅依赖LiDAR 数据单方面增强 RGB 数据以进行特征表征,忽略了图像和 LiDAR 之间的双向互补性,导致信息丢失和错误累积,尤其在复杂场景下表现不佳。

提出的方案

BiFusion 提出了一种双边模态交互策略,通过在表示学习和路径点预测两个阶段实现图像和 LiDAR 数据的双向交互。BiFusion 不仅保留了各模态的独立特征,还通过跨模态模块促进信息交换和融合,从而提升感知和规划能力。

应用的技术

-

CRIM:结合跨视图位置嵌入和注意力机制,实现图像和 LiDAR 特征的双边交互。

-

CPIM:通过掩码自注意力机制捕捉路径点的时空依赖,并利用注意力机制实现跨模态预测交互。

-

多任务学习:引入图像分割和 BEV 地图预测作为辅助任务,指导特征学习,提升模型鲁棒性。

达到的效果

在 Carla Town05 Long 基准测试 中,BiFusion 取得了驾驶分数(DS)69.6、路线完成率(RC)99.8 和违规分数(IS)0.70,显著优于现有方法,展示了其在交通灯处理、避障和导航等复杂场景中的卓越性能。Carla 在此提供了 Town05 Long 的测试环境,模拟了多样的道路条件和动态障碍,确保评估的全面性和真实性。

方法:基于双边模态交互的多模态驾驶

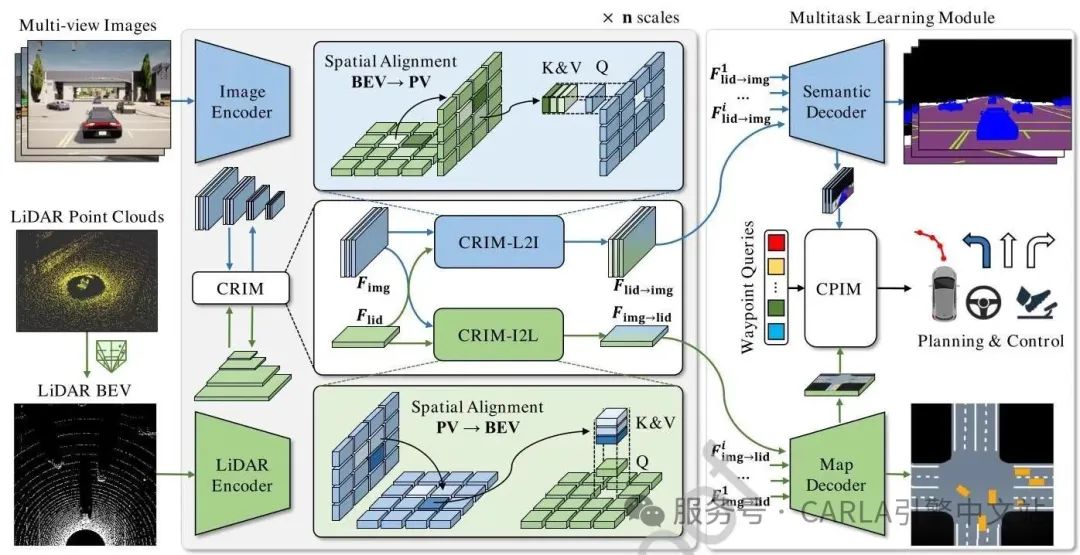

BiFusion 的核心在于通过双边模态交互充分利用图像和 LiDAR 数据的互补性,避免传统单边融合的局限性。其网络结构包括特征编码器(含 CRIM)、路径点解码器(含 CPIM)和多任务学习模块。

BiFusion 网络结构

BiFusion 采用双流设计,分别处理图像和 LiDAR 数据:

-

特征编码器:通过 CRIM 在多尺度上实现图像和 LiDAR 特征的交互融合。

-

路径点解码器:通过 CPIM 实现路径点预测中的跨模态交互。

-

多任务学习模块:通过辅助任务(如图像分割和 BEV 地图预测)指导特征学习。

CRIM:跨模态表示交互模块

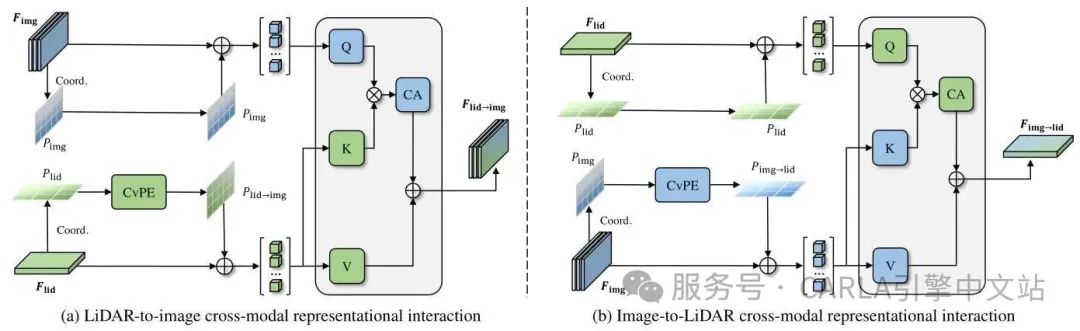

CRIM 通过以下步骤实现双边交互:

-

跨视图位置嵌入(CvPE):建立图像(PV)和 LiDAR(BEV)特征间的几何对应关系。

-

基于注意力的表示交互:利用跨视图注意力机制融合特征,例如从图像到 LiDAR(CRIM-I2L)和从 LiDAR 到图像(CRIM-L2I)。

CRIM 模块示意图:CRIM 通过双向交互增强图像和 LiDAR 特征的表示能力

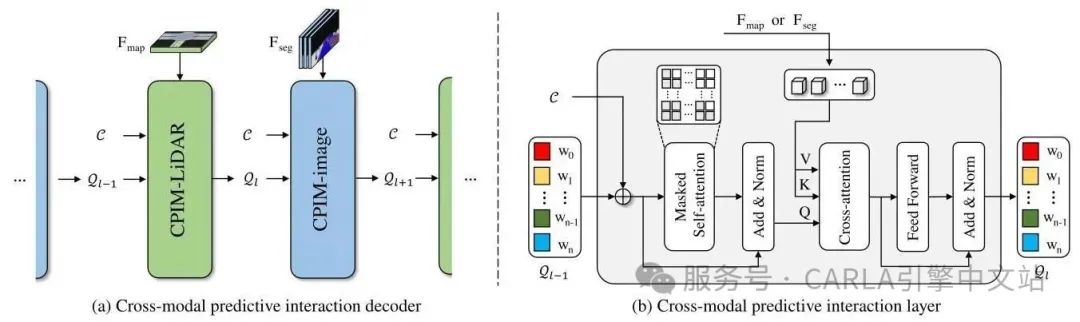

CPIM:跨模态预测交互模块

CPIM 在路径点预测中实现跨模态交互:

-

掩码自注意力机制:捕捉路径点的长程时空依赖,支持自回归预测。

-

基于注意力的预测交互:交替利用图像和 LiDAR 特征精化路径点预测。

CPIM 模块示意图:CPIM 通过跨模态交互提升路径点预测的准确性

多任务学习模块

通过图像分割(7 类,如车辆、道路等)和 BEV 地图预测(3 类,如道路、车道线等)任务,提供密集监督,增强特征表示能力和模型鲁棒性。

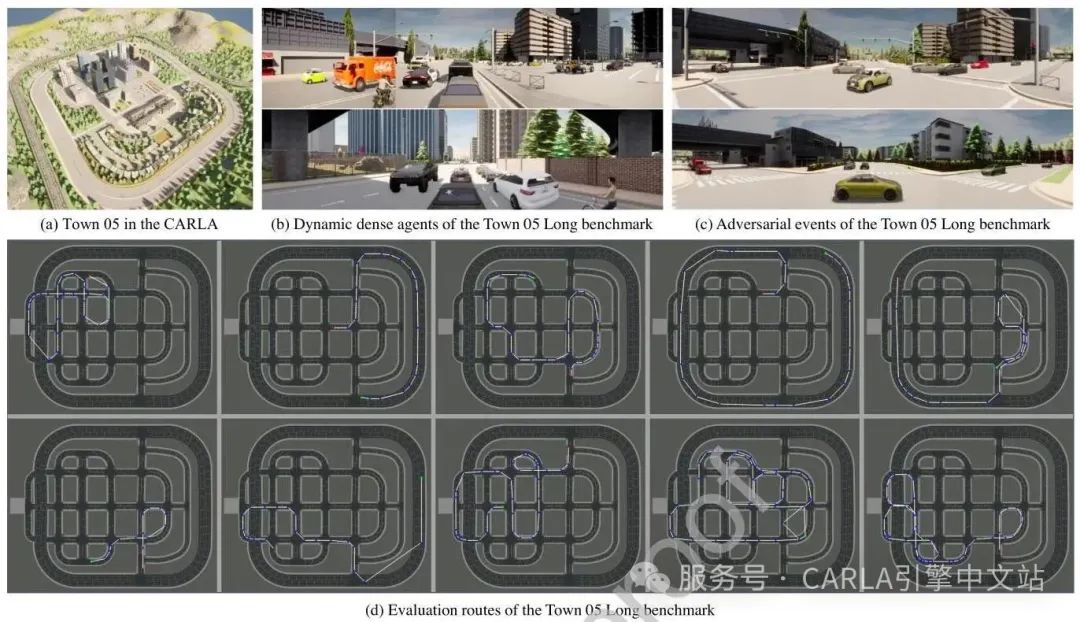

实验:Carla 模拟器验证 BiFusion 性能

实验设置

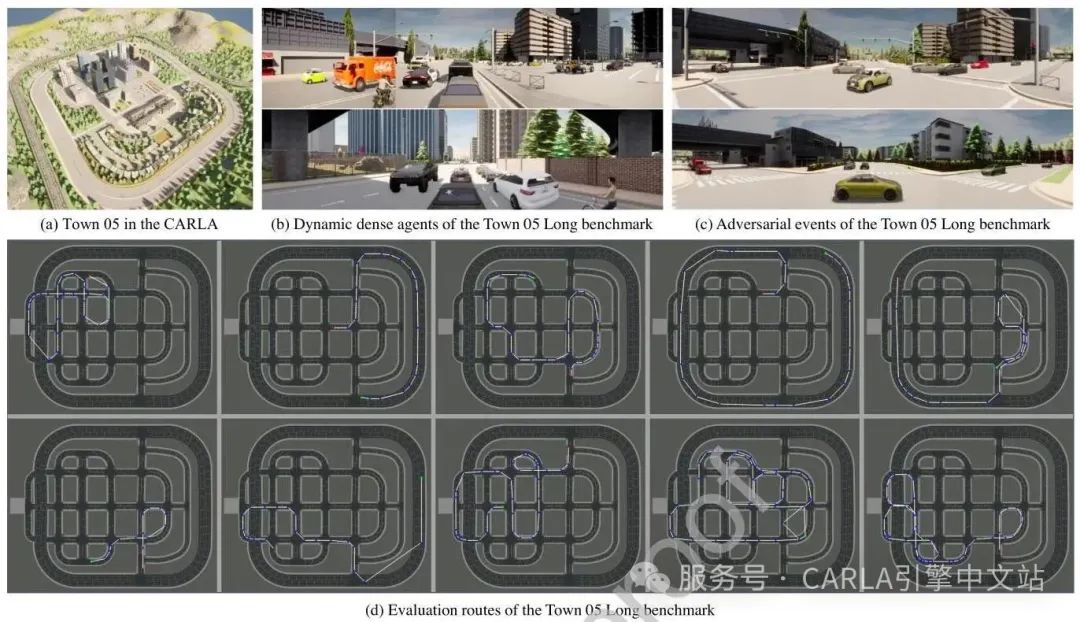

实验在 Carla 模拟器(版本 0.9.10) 中进行,使用 Town05 Long 基准测试评估 BiFusion。Carla 在此提供了 8 个城镇的多样化驾驶环境,生成** 231K 帧训练数据**(包含图像、LiDAR 点云等),并通过 Town05 Long 的 10 条长路线(1000-2000 米)测试模型性能。Town05 Long 包含多车道、高速公路、桥梁等复杂场景,以及动态障碍和恶劣天气,确保实验的挑战性。

Town05 Long 基准测试的评估路线和场景:红点为起点,绿点为终点,蓝点为目标点

定量分析

BiFusion 在关键指标上表现出色:

-

驾驶分数(DS):69.6 ± 1.0

-

路线完成率(RC):99.8 ± 0.31

-

违规分数(IS):0.70 ± 0.01

与现有方法(如 Transfuser、Interfuser 等)相比,BiFusion 在 DS 和 RC 上均领先,展示了其在复杂场景中的优越性。

Town05 Long 基准测试的性能比较:BiFusion 在 DS、RC 和 IS 上表现突出

消融研究

消融实验验证了各组件的有效性:

-

CRIM:移除后 DS 下降 10.7%,RC 下降 20.1%。

-

CPIM:移除后 DS 下降 4.2%,RC 下降 17.0%。

-

辅助任务:移除全部辅助任务后 DS 从 70.5 降至 46.5。

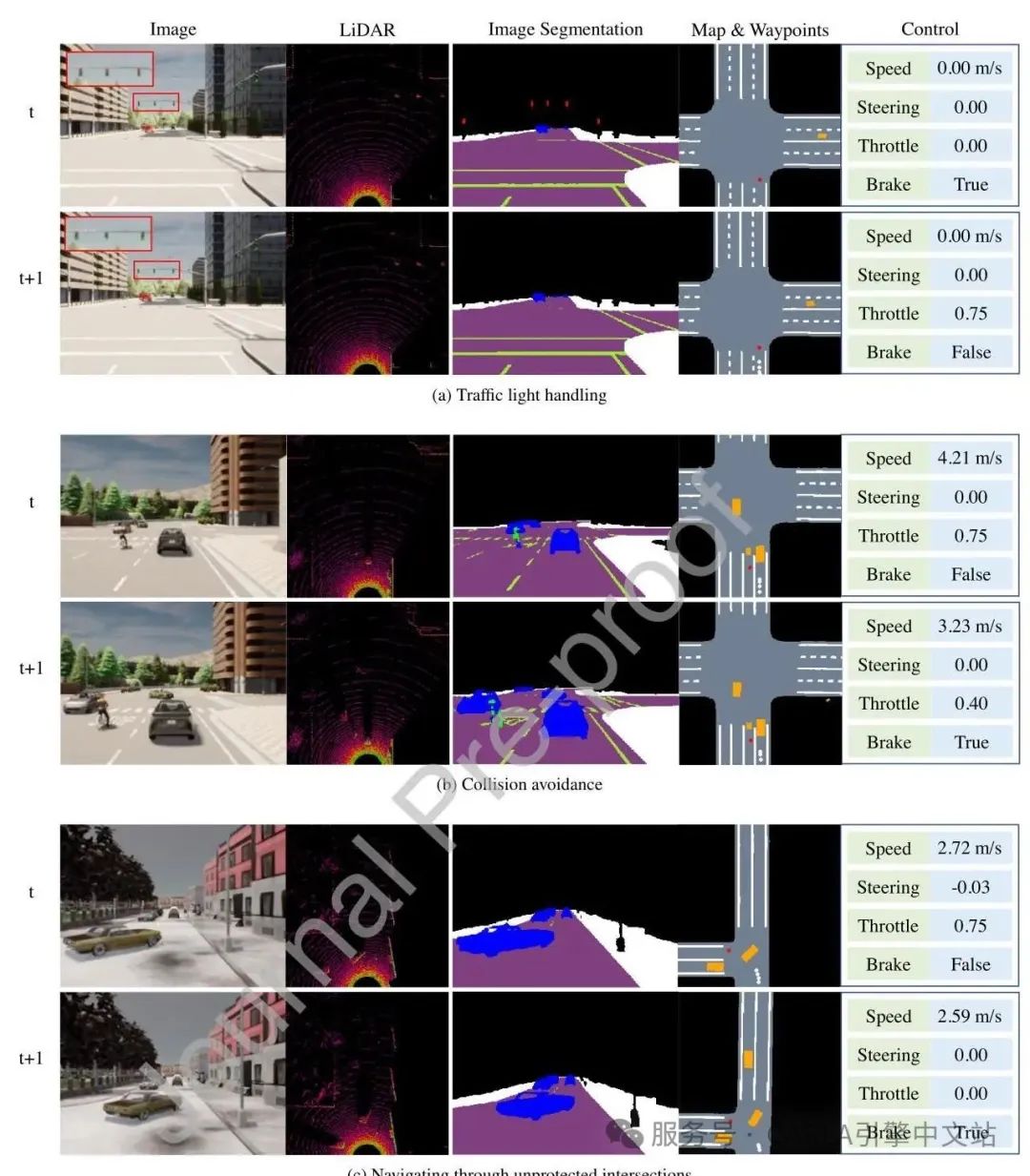

定性分析

BiFusion 在以下场景中表现优异:

-

交通灯处理:准确识别红绿灯状态并停车或启动。

-

避障:通过减速和刹车避免碰撞。

-

无保护交叉口导航:安全通过复杂路口。

BiFusion 在挑战性场景中的定性结果:白点为预测路径点,红点为全局导航点

Carla 的贡献

Carla 模拟器 在 BiFusion 研究中至关重要:

-

数据生成:提供了多模态训练数据(如图像、LiDAR 点云),覆盖 21 种天气条件和多样化场景。

-

基准测试:Town05 Long 在 Carla 中实现,包含长路线和动态障碍,用于全面评估 BiFusion。

-

场景模拟:模拟交通灯、障碍物和恶劣天气等复杂条件,确保实验结果贴近现实。

结论

BiFusion 提出了一种创新的双边模态交互策略,通过在表示学习和路径点预测中实现图像和 LiDAR 数据的双向互补,显著提升了多模态端到端自动驾驶系统的性能。实验结果表明,BiFusion 在 Carla Town05 Long 基准测试中取得了驾驶分数(DS)69.6、路线完成率(RC)99.8 和违规分数(IS)0.70,超越了现有最先进的方法。未来研究将探索如何进一步优化双边交互机制,并将 BiFusion 扩展到更多模态和场景中。

引用格式

Yu, Z., Li, J., Chen, Z., Wei, Y., Zhang, X., & Tan, X. (2025). Multimodal End-to-End Autonomous Driving via Bilateral Modality Interaction. Expert Systems with Applications, 128458.

💬 互动话题

本文提出的BiFusion方法通过双边模态交互,成功在CARLA模拟器的Town05 Long基准测试中展现了优异的驾驶性能,验证了多模态融合在端到端自动驾驶中的强大潜力。得益于CARLA的高保真仿真环境,BiFusion不仅显著提升了系统的感知与规划能力,还为未来的自动驾驶研究开辟了新的方向。

你在阅读本文后,是否对CARLA在多模态自动驾驶研究中的应用有了新的认识?你在使用CARLA进行仿真实验时,遇到过哪些技术难题或挑战?欢迎在留言区或社群中分享你的看法和经验!我们将优先挑选最受关注的问题,安排详细的技术解析~

📢 加入社群添加小助手vx【synkrotron1】,备注“CARLA”即可加入开发者交流群,获取最新资源与1V1答疑!

END

往期推荐:

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)