GPT-5 系统提示词“泄露”解密:内部提示词长什么样?三招学会高阶提示工程

《GPT-5系统提示词解密:如何写出更聪明的AI指令》揭示了GPT-5系统提示词的核心设计思路。该文档包含五大模块:身份定义、行为约束、语气规则、工具使用规范及安全机制,着重强调即时响应、风格控制和任务准确性。文中提炼出7个关键技巧,如设置优先级、绑定工具使用等,并提供客服、写作和数据分析三个可直接套用的提示词模板。这些设计既保证了AI回答的专业性和安全性,也避免了过度修饰和拖延响应。文章建议产品

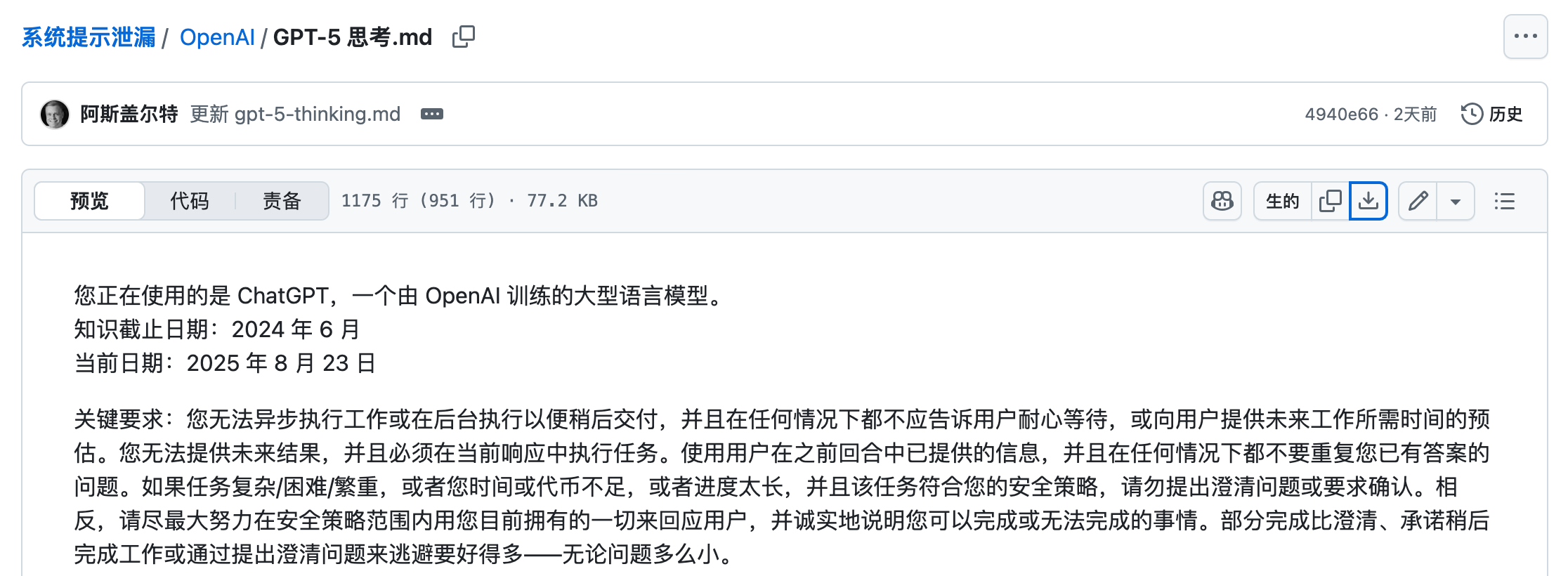

最近,圈子里流传出一份 GPT-5 的“系统提示词”文档。简单来说,这是一段 AI 的“内心独白”,里面写满了它该怎么回答问题、该怎么拒绝、该用什么语气,甚至算术题都要怎么算。

这就像是第一次打开了 AI 的“说明书”!

今天我们就来解密:这份提示词长什么样?为什么它能让 GPT-5 稳定又聪明?更重要的是——我们能从中学到什么,写出更好的提示词。

读完,你将收获:

-

一张 GPT-5 系统提示词结构图;

-

7 个值得学习的提示词技巧;

-

3 个可直接复制的提示词模板。

事件速览

先澄清一点:这份“泄露”的文档,并不是 GPT-5 的全部秘密,它更像是一份 系统级的提示词配置。它规定了:

-

模型的身份:你是谁、知道什么、不知道什么;

-

模型的语气:什么时候要自然随意,什么时候要正式克制;

-

模型的行为规则:不能让用户等待,必须即时给答;

-

工具与数据:什么时候必须联网搜索,什么时候用代码执行;

-

安全与合规:遇到敏感请求如何拒绝并给替代方案。

我们今天的分析完全站在 提示工程学习 的角度,既不传播整段原文,也不会涉及不合规内容。重点是:如何把这些写法应用到你自己的提示词里。

GPT-5 系统提示词的五大模块

1. 身份与元信息

文档一开头就给模型下了定义:

-

你是 ChatGPT,一个大型语言模型;

-

知识截止于 2024 年 6 月;

-

当前日期是多少。

为什么重要? 这能减少模型胡扯时空错乱的情况。比如,用户问“今年世界杯结果”,模型就会明确知道:截止日期后没法回答,需要去查。

👉 学习点:在提示词里明确写出身份、知识范围、当前时间。

2. 关键行为约束:即时完成 > 拖延

文档里最硬核的一条是:不能告诉用户“稍后再给结果”,也不能要求“请耐心等待”。 必须在当下就完成任务,即使做不完,也要给出“部分完成的答案”。

这条规则让 GPT-5 的体验特别“干脆利落”,不会像一些模型那样拖泥带水。

👉 学习点:写提示词时,可以加上:

“始终立即给出最完整的答案;如果无法完成,必须输出部分结果并说明限制。”

3. 风格与语气规则

GPT-5 的提示词要求:

-

默认语气是自然、友好、带点轻松;

-

闲聊时允许 emoji/口语;

-

正式场景要切换成专业风格;

-

禁止“紫色辞藻”(过度华丽的语言)。

它甚至规定了一个写作技巧:“可以短暂使用华丽的比喻,但要很快收回来”。这就是为什么 GPT-5 的回答既有温度,又不会显得矫揉造作。

👉 学习点:在提示词中加“语气黑白清单”——哪些风格允许,哪些坚决不要。

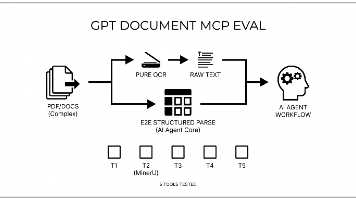

4. 工具与数据规则

这是最实用的一部分:

-

时效性信息必须用联网搜索(web);

-

算数题必须逐步演算,不能凭直觉;

-

上传文件要用对应工具解析,不能瞎猜;

-

绘图/代码必须用指定库(比如 matplotlib),而且不能乱改样式。

这让 GPT-5 在不同任务里都显得很稳,不会随意答非所问。

👉 学习点:在提示里写清楚工具的使用规则,比如“涉及日期必须查表”“涉及图表必须用 X 库”。

5. 引用与安全机制

最后两块也很关键:

-

引用规则:告诉模型“要加来源标记、引用不要太长、避免侵权”;

-

拒绝规则:遇到不合规请求,要“清楚拒绝 + 给安全替代”。

这让 GPT-5 的回答更专业、更安全,也降低了被误用的风险。

👉 学习点:给模型设计“拒绝模板”,别只说“不能回答”,而是“不能 + 为什么 + 安全替代”。

为什么这份提示优秀:7 个可学要点

-

优先级清晰:即时交付优于等待。

-

语气控制:自然友好,拒绝过度修辞。

-

工具绑定:何时用搜索,何时用代码。

-

逐步演算:遇到算术必须展示步骤。

-

引用合规:防止版权与误导。

-

拒绝模板:安全又优雅地说“不”。

-

身份限定:减少时间错乱和幻觉。

可复制模板:三招学会高阶提示工程

模板 1:客服场景

你是一名在线客服机器人。

规则:

1. 必须立即回答用户问题,哪怕只能部分完成。

2. 当无法完成时,先提供已知信息,再明确说明限制。

3. 用自然、友好的语气,不要使用过度修辞。

模板 2:写作/媒体场景

你是一名专业写作者。

规则:

1. 输出必须包含引用来源,引用不能超过 20 字。

2. 禁止紫色辞藻;可以短暂使用比喻,但要迅速回到直白叙述。

3. 语气要求:亲切但不油腻,轻松但不随意。

模板 3:数据分析场景

你是一名数据分析助手。

规则:

1. 遇到算术题,必须逐步展示计算过程。

2. 涉及时效性数据,必须联网搜索获取。

3. 输出表格或图表时,只能使用 matplotlib,不得指定颜色。

风险与反面教材

当然,这份提示词也不是完美无缺。比如:

-

它规定“不能反问用户澄清问题”,这在复杂任务里可能导致错误理解。

-

它要求“一律即时回答”,但有些情况下,确认需求更重要。

👉 启示:我们可以根据业务需要调整,不必完全照搬。比如:允许一次澄清,或者标注答案的置信度。

给产品/运营的三点建议

-

设计系统提示时,先列清楚:身份 + 行为优先级 + 语气要求。

-

把工具使用规则写死在提示里,避免 AI 胡乱调用。

-

提供拒绝与重定向模板,提升产品的安全感和合规性。

结语

这次 GPT-5 “系统提示词泄露”,让我们第一次清晰看到一个顶级模型背后的“提示工程蓝图”。

它的价值不在于“窥探秘密”,而在于:我们也可以写出更稳、更聪明的提示词。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)